💡Python爬虫实战:高效下载简历模板(含极简免费模板656款)| 精选1篇范文参考

OMG!姐妹们,挖到宝了!🕵️♀️ 用Python爬虫实战,轻松搞定简历模板下载,简直不要太香!👩💻 省时省力,效率翻倍!告别手动一个个找,代码跑起来,模板自动到碗里来~ 🍚 快来一起学习,让找简历模板变得so easy!🔥 #Python爬虫 #简历模板 #效率神器

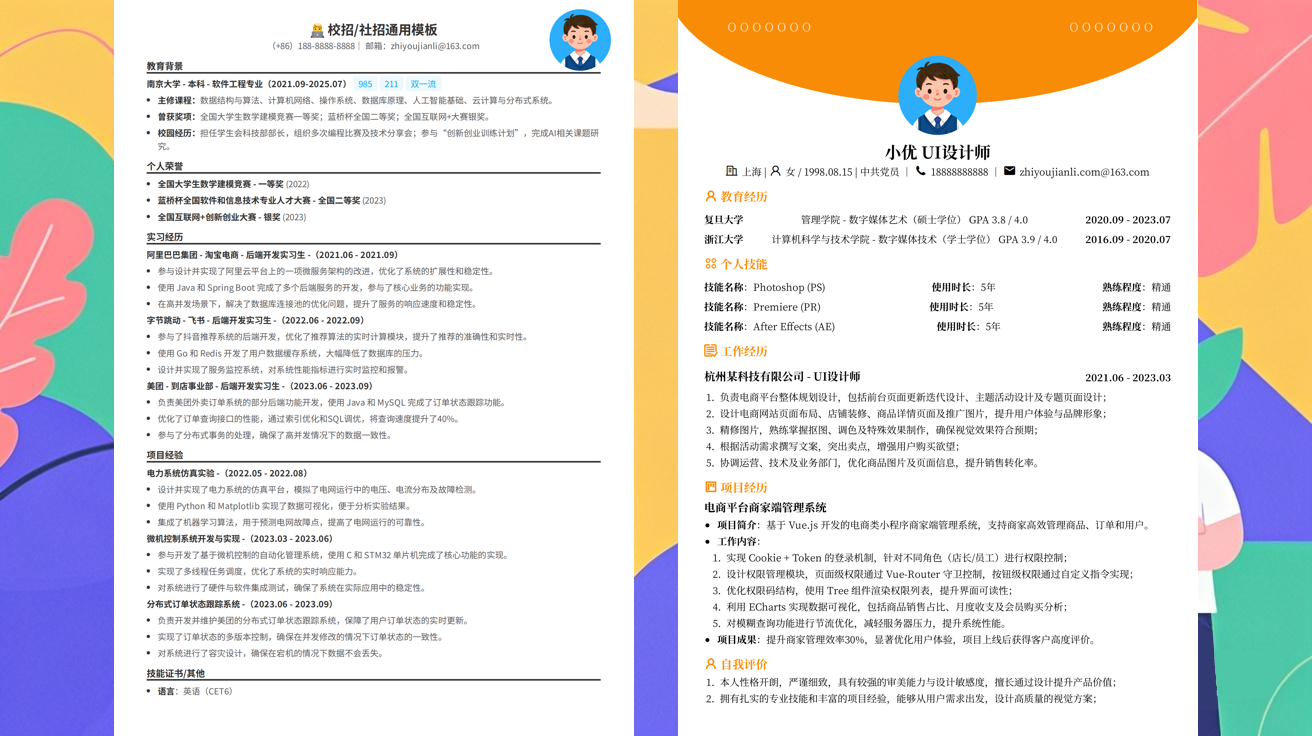

范文1

Python爬虫实战:高效下载简历模板📄✨

姐妹们!最近是不是都在忙着准备简历,找模板找范文简直是头大?😭 别担心!今天就来分享一个超实用的Python爬虫小技巧,让你一键高效下载简历模板,省时又省力!👩💻💨

🌟 什么是Python爬虫?

简单来说,Python爬虫就是用Python编写程序,自动从网页上抓取你需要的数据。对于我们来说,就是自动下载各种简历模板和范文!听起来是不是超级酷?😎

📝 准备工作

在开始之前,我们需要准备几个东西:

- Python环境:确保你的电脑已经安装了Python,可以去官网下载最新版本:Python官网

-

爬虫库:我们主要使用

requests和BeautifulSoup这两个库,可以用pip安装: bash pip install requests beautifulsoup4 -

目标网站:比如一些提供免费简历模板的网站,比如:

- 职优简历简历模板

- 模板之家

- WPS简历模板

🛠️ 实战操作

第一步:分析网页结构

打开你想要爬取的网站,右键点击模板图片,选择“检查”或“检查元素”,找到图片的URL地址。通常图片URL会在<img>标签的src属性里。

第二步:编写爬虫代码

新建一个Python文件,比如download_resume_templates.py,然后输入以下代码:

python import requests from bs4 import BeautifulSoup import os

创建保存文件的目录

if not os.path.exists('resume_templates'): os.makedirs('resume_templates')

def download_template(url, filename): """下载单个模板""" try: response = requests.get(url) response.raise_for_status() with open(filename, 'wb') as f: f.write(response.content) print(f"成功下载:{filename}") except Exception as e: print(f"下载失败:{url},错误:{e}")

def main(): """主函数""" # 目标网站URL url = 'https://www.canva.com/zh-cn/resume/'

# 发送请求

response = requests.get(url)

response.raise_for_status()

# 解析网页

soup = BeautifulSoup(response.text, 'html.parser')

# 找到所有模板图片

templates = soup.find_all('img', alt=True)

for i, template in enumerate(templates[:10]): # 只下载前10个

img_url = template['src']

# 处理相对路径

if not img_url.startswith('http'):

img_url = 'https:' + img_url

filename = os.path.join('resume_templates', f'resume_{i+1}.jpg')

download_template(img_url, filename)

if name == 'main': main()

第三步:运行爬虫

保存文件后,在终端中运行:

bash python download_resume_templates.py

几秒钟后,你就会发现resume_templates文件夹里已经下载了多个简历模板!🎉

💡 小贴士

- 尊重网站规则:有些网站可能不允许爬取,记得查看网站的

robots.txt文件,遵守规则哦! -

设置延时:如果一次性请求太多,可能会被网站封禁,可以在请求之间加入延时: python import time time.sleep(1) # 延时1秒

-

处理反爬机制:有些网站会检测User-Agent,可以修改请求头: python headers = { 'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/58.0.3029.110 Safari/537.3' } response = requests.get(url, headers=headers)

🌈 扩展功能

这个基础的爬虫还可以扩展:

- 自动重试:下载失败时自动重试

- 多线程下载:同时下载多个模板,加快速度

- PDF格式下载:有些网站提供PDF模板,可以扩展支持下载

🎁 结束语

姐妹们,用Python爬虫下载简历模板是不是超级简单?😍 以后再也不会为找模板烦恼啦!赶紧试试吧!如果遇到问题,欢迎在评论区留言交流哦~💬

记得点赞收藏,下次需要的时候随时查看!🌟

Python爬虫 #简历模板 #效率工具 #自学Python #编程干货

发布于:2025-12-01,除非注明,否则均为原创文章,转载请注明出处。