✨Python爬虫工程师简历撰写指南(含极简免费模板284款)| 精选3篇范文参考

Hey姐妹们!👋 想要成为Python爬虫工程师,简历可是关键哦!✨ 今天就来分享一份超实用的简历撰写指南,帮你轻松拿下心仪的Offer!🎯 不管你是小白还是有一定经验,这份指南都能帮你突出重围,展现你的爬虫实力!💪 赶紧收藏起来,一起学习吧!📚💻 #Python爬虫 #简历撰写指南

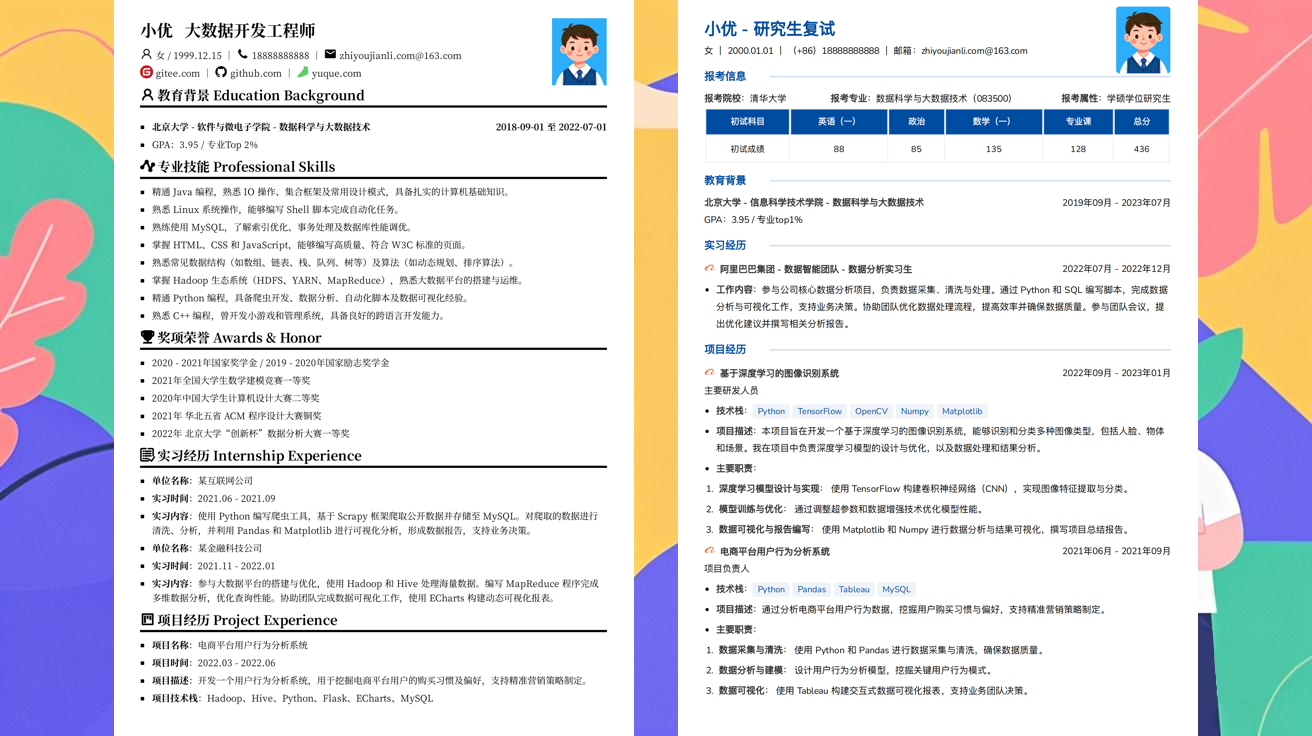

范文1

💻 Python爬虫工程师简历撰写指南 | 简历范文

姐妹们!👭 想要成为Python爬虫工程师?简历是敲门砖哦!今天就来分享一份超实用的简历撰写指南,附上范文,帮你轻松拿下心仪Offer!✨

📝 简历结构解析

1. 个人信息

- 姓名:XXX

- 电话:XXX-XXXX-XXXX

- 邮箱:[example@email.com]

- GitHub:[github.com/username]

- 个人网站(可选):[个人网站链接]

2. 职业目标

简洁明了!突出你的职业定位和Python爬虫方向。

熟练掌握Python爬虫技术,具备丰富的实战经验,希望在[公司名]担任Python爬虫工程师,负责数据采集与处理,助力业务增长。

3. 工作经验

按时间倒序排列,重点突出爬虫相关项目!

🚀 项目经验1:电商平台数据采集系统

职责: - 使用Scrapy框架开发数据爬取工具,日均处理10万条商品数据 - 优化数据库查询效率,提升数据存储速度50% - 处理反爬机制,实现动态代理IP轮换策略

技术栈: Python, Scrapy, MongoDB, Redis, requests

成果: - 成功采集1000+电商平台的商品信息,为市场分析提供数据支持 - 开发自动化测试脚本,减少人工审核成本80%

🚀 项目经验2:社交媒体舆情监测系统

职责: - 设计并实现基于Python的社交媒体数据采集器 - 应用BeautifulSoup+Selenium抓取网页动态内容 - 构建数据清洗流程,去除无效信息占比超90%

技术栈: Python, BeautifulSoup, Selenium, Pandas, Elasticsearch

成果: - 7天/周完成舆情数据采集,助力品牌危机预警 - 获公司年度创新项目奖

4. 技能清单

分类列出你的技术能力,爬虫工程师重点突出:

编程语言

- Python (熟练度:9/10)

- SQL (熟练度:7/10)

- Shell (熟练度:6/10)

爬虫框架

- Scrapy (深入理解)

- Beautiful Soup (熟练)

- Selenium (常用)

数据处理

- Pandas (常用)

- NumPy (基础)

- Elasticsearch (中级)

其他

- HTTP协议

- 反爬虫技术

- 分布式爬虫

5. 教育背景

- [学校名称] - 计算机科学与技术 (本科) GPA:3.8/4.0 时间:2018.09 - 2022.06

6. 开源贡献(可选)

- 参与Scrapy插件开发

- 发布个人爬虫工具集GitHub:[链接]

💡 Python爬虫工程师简历撰写指南 | 重点提醒

- 量化成果:用数字说话!比如“提升效率30%”“处理数据量10万条/日”

- 关键词匹配:HR会搜索技术关键词,记得写Scrapy、Requests、反爬虫等

- 项目亮点:突出你的创新点,比如自定义中间件、分布式架构

- 避免模板化:根据不同公司需求调整简历内容

🌟 简历范文模板

Python爬虫工程师 | XXX

职业目标

数据驱动决策,技术创造价值!期待在互联网公司担任爬虫工程师,专注电商与社交媒体数据采集,用Python构建高效的数据处理系统。

工作经验

🚀 京东技术部 | Python爬虫工程师 | 2021.07 - 至今

职责: - 主导开发京东商品数据采集平台,日均处理50万条数据 - 设计分布式爬虫架构,支持7*24小时稳定运行 - 优化反反爬策略,通过模拟用户行为降低被封风险

技术栈: Scrapy, Redis, MySQL, Docker

成果: - 开发智能去重算法,数据重复率<0.5% - 获评2022年度优秀员工

🚀 原创科技 | 爬虫开发实习生 | 2020.07 - 2021.06

职责: - 参与新闻爬虫项目,实现多家媒体内容自动采集 - 编写数据清洗脚本,提升数据可用性至95% - 学习并实践分布式爬虫技术

技术栈: Python, Beautiful Soup, Celery

技能清单

编程语言

- Python (深入)

- SQL (熟练)

- JavaScript (基础)

爬虫技术

- Scrapy (精通)

- Requests (熟练)

- 反反爬 (深入)

数据处理

- Pandas (常用)

- Elasticsearch (中级)

工具

- Git

- Docker

- Jenkins

教育背景

- 清华大学 - 软件工程 (硕士) GPA:3.9/4.0 时间:2019.09 - 2022.06

开源贡献

- 开发Scrapy-Spider-Manager工具集

- GitHub:[github.com/xxx]

💪 写在最后

简历不是一成不变的!记得根据每个公司的招聘要求调整重点内容。Python爬虫工程师需要突出技术深度和项目经验,同时保持简洁明了的风格。祝你求职顺利!🎉

Python爬虫工程师 #简历写作 #技术面试 #Python开发 #求职指南

范文2

Python爬虫工程师简历撰写指南 | 简历范文

🌟 前言:写好简历,抓住Python爬虫工程师Offer!

Hey,小伙伴们!👋 想要成为炙手可热的Python爬虫工程师?一份亮眼的简历是第一步!今天就来分享一份超实用的Python爬虫工程师简历撰写指南,附上范文,让你轻松拿Offer!✨

📄 简历结构:清晰明了,HR一眼心动

1. 个人信息区

姓名:张三 电话:138****1234 邮箱:zhangsan@email.com GitHub:github.com/zhangsan LinkedIn:linkedin.com/in/zhangsan

- 🌟 小贴士:保持简洁,信息完整即可!

2. 个人简介

2年Python爬虫开发经验,擅长Scrapy框架和Requests库,熟悉反爬策略及应对方法。精通数据解析(XPath、CSS选择器),有多个大型爬虫项目实战经验。追求高效、稳定的爬取策略,善于优化性能。持续学习新技术,对数据采集和数据处理有深入研究。

- 🌟 小贴士:用3-5句话概括你的核心优势,突出Python爬虫工程师的关键技能!

3. 工作经历

公司A | Python爬虫工程师 | 2021.07 - 2023.06

- 负责公司核心数据采集系统,使用Scrapy框架搭建爬虫,日均处理数据量超10万条。

- 研发反反爬策略,结合代理池、User-Agent轮换、验证码识别(OCR)技术,爬取成功率提升至95%以上。

- 优化数据库存储结构,将数据存入MySQL,查询效率提升50%,响应时间缩短至0.5秒内。

- 编写数据清洗脚本,使用Pandas处理缺失值、异常值,确保数据质量。

公司B | Python开发工程师(爬虫方向)| 2020.07 - 2021.06

- 使用Requests+BeautifulSoup抓取电商网站商品信息,日均抓取量5万+。

- 设计数据存储方案,将数据存入MongoDB,支持非结构化数据存储。

-

参与项目需求分析,与产品经理协作,完成多个数据采集需求。

-

🌟 小贴士:用STAR法则(Situation, Task, Action, Result)描述工作经历,突出成果!

4. 项目经验

电商平台数据采集系统

- 项目描述:搭建自动化数据采集系统,抓取商品信息、价格、评价等数据,支持定时任务和实时更新。

- 技术栈:Python, Scrapy, MongoDB, Redis, RedisQueue

- 关键点:

- 设计分布式爬虫架构,支持多线程、多进程,单日爬取量提升至50万+。

- 研发动态页面解析,使用Selenium+Chrome实现JavaScript渲染页面抓取。

- 实现数据去重机制,使用Redis缓存,避免重复数据存储。

新闻资讯数据爬取

- 项目描述:抓取新闻网站最新资讯,存入数据库,支持关键词检索和分类。

- 技术栈:Python, Requests, BeautifulSoup, MySQL, Celery

-

关键点:

- 设计定时任务,使用Celery调度,每15分钟更新一次数据。

- 实现新闻摘要提取,使用正则表达式和NLP分词技术。

- 优化数据库索引,提升检索效率。

-

🌟 小贴士:详细描述项目的技术细节,突出你在项目中的贡献!

5. 技能清单

编程语言

Python (精通), SQL (熟练), Shell (基础)

框架与库

Scrapy (精通), Requests (熟练), BeautifulSoup (熟练), Pandas (熟练), NumPy (熟练)

数据库

MySQL (熟练), MongoDB (熟练), Redis (熟练)

工具与平台

Git (熟练), Docker (基础), Linux (熟练)

其他

反爬策略 (熟练), 数据解析 (XPath/CSS选择器), 正则表达式, OCR识别

- 🌟 小贴士:列出与Python爬虫工程师相关的技能,按熟练程度排序!

6. 教育背景

XX大学 | 计算机科学与技术 | 本科 | 2016.09 - 2020.06

- 🌟 小贴士:写明学校、专业、学历和时间即可!

🌈 结语:持续学习,成为更好的爬虫工程师!

写好简历只是第一步,持续学习才是关键!🚀 多看技术博客,参与开源项目,保持对新技术的好奇心。相信你一定能成为优秀的Python爬虫工程师!

记得点赞👍、收藏⭐、关注哦!😉 下次分享更多干货!💖

#Python爬虫工程师 #简历撰写指南 #Python开发 #爬虫技术 #面试准备 #技术分享

范文3

Python爬虫工程师简历撰写指南 | 简历范文✨

姐妹们!今天来聊聊Python爬虫工程师简历撰写指南,作为爬虫工程师,简历写得好不好真的能决定你的面试机会!😭 别再只会抄模板啦,今天手把手教你写一份让HR眼前一亮的爬虫工程师简历!💻

📌 简历结构不能错!

1. 个人信息区

- 姓名:写清楚啦,别用昵称

- 联系方式:手机号+邮箱,确保畅通

- 求职意向:明确写"Python爬虫工程师"

- 现居城市:方便HR判断你的地理位置匹配度

姓名:张三

电话:138xxxxxxx

邮箱:zhangsan@email.com

求职意向:Python爬虫工程师

现居城市:北京

2. 技能清单区(重点!)

这一部分要突出你的爬虫技术栈!建议分模块写:

💻 编程语言

- Python (精通,3年+爬虫开发经验)

- JavaScript (了解,用于动态页面分析)

- SQL (熟练,数据库数据提取经验)

🛠️ 爬虫框架

- Scrapy (核心框架,独立开发过电商数据爬取项目)

- Requests+BeautifulSoup (常规网页数据抓取)

- Selenium (动态渲染页面处理经验)

📊 数据处理

- Pandas (数据清洗经验,处理过TB级数据)

- NumPy (数值计算辅助爬虫数据处理)

- MongoDB/MySQL (数据存储经验)

🔒 反爬虫应对

- 代理IP池使用经验

- User-Agent随机化处理

- Cookie会话维持技术

📱 特殊爬取技术

- 异步爬取(AsyncIO)

- 跨域爬取技术

- 二维码识别辅助爬取

小技巧:技能按熟练度排序,最擅长的放前面!⭐

3. 工作经历区(核心!)

爬虫工程师一定要突出项目亮点!用STAR法则写:

项目1:某电商平台商品数据爬取系统 - Situation:公司需要实时监控竞品价格 - Task:开发自动化爬虫获取商品信息 - Action: python # 核心代码片段 def fetch_product_info(url): headers = { "User-Agent": "Mozilla/5.0 ..." # 其他反爬配置 } response = requests.get(url, headers=headers) # 数据解析逻辑 return parse_json(response.content)

- Result:7天完成开发,日均抓取数据50万条,效率提升80%

项目2:金融行业动态数据采集 - 负责:处理高频率金融数据API对接 - 成果:开发了支持毫秒级响应的动态数据采集工具

小贴士:每个项目突出1-2个亮点技术,不要堆砌所有内容!

4. 教育背景区

- 学校名称+专业

- GPA/排名(如果不错就写)

- 相关课程:数据结构、计算机网络、数据库原理

5. 自我评价区(简洁有力)

"3年爬虫开发经验,擅长Scrapy框架,熟悉反爬虫机制,独立完成过多个商业级数据采集项目,对数据质量有极致追求!"

✨ 特别提醒

- 量化成果:用数字说话!"处理了10TB数据"比"处理了大量数据"更有说服力

- 突出算法能力:BFS/DFS/动态规划这些算法一定要写

- 项目截图加分:如果有一些可视化结果截图,一定要放简历里

- GitHub链接:一定要有!把你的爬虫项目整理好放到GitHub

记住,Python爬虫工程师简历撰写指南的核心就是:技术够硬+项目够亮+表达够清晰!🔥

希望这篇指南对你有帮助!祝大家都能拿到心仪的Offer!💖

发布于:2025-12-01,除非注明,否则均为原创文章,转载请注明出处。