📌Python爬虫面试简历撰写指南(含极简免费模板823款)| 精选3篇范文参考

Hey 姐妹们!👋 想不想让Python爬虫面试简历脱颖而出?✨ 今天就来分享超实用的简历撰写指南!告别模板化,让你的技能和项目经验C位出道!🚀 不管是爬虫大神还是小白,这篇指南都能帮你优化简历,给面试官留下深刻印象!💼 快来一起学习,让你的简历成为HR的心动选择吧!💖 #Python爬虫 #面试简历 #求职必备

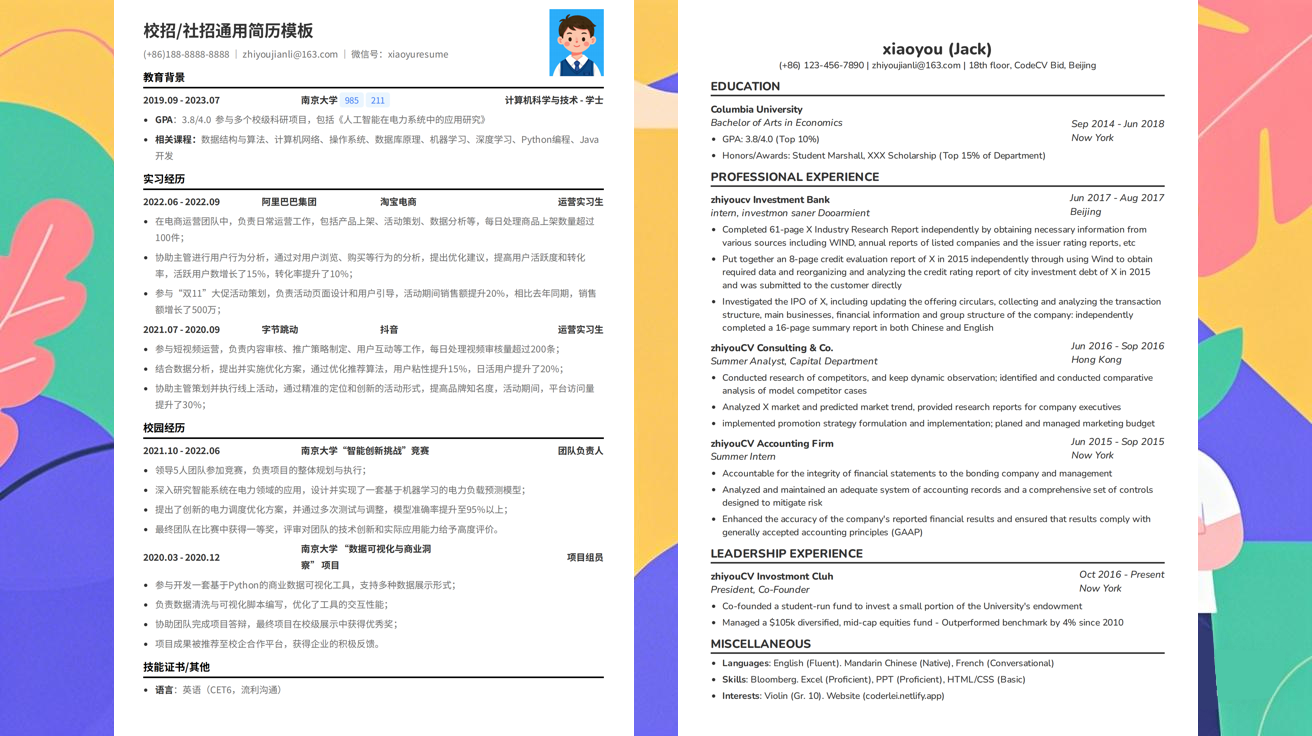

范文1

Python爬虫面试简历撰写指南 | 简历范文分享💼🐍

哈喽,小伙伴们!👋 今天要跟大家聊聊Python爬虫面试简历撰写指南,如何让你的简历在众多求职者中脱颖而出,抓住面试官的心!😉 作为爬虫开发者,简历更是展现你技术实力的第一关,赶紧拿出小本本记下来哦~

一、简历结构要清晰

一份好的简历,结构清晰是关键!📈 一般包括以下几个部分:

- 个人信息

- 姓名、联系方式(电话+邮箱)、GitHub/博客链接(如果有)

-

面试时可能会问到个人项目,提前准备好哦~

-

专业技能

- Python爬虫相关:Requests、BeautifulSoup、Scrapy、Selenium、XPath、CSS选择器等

- 数据库:MySQL、MongoDB等

-

其他技能:Linux基础、Git、数据分析工具(Pandas、NumPy)等

-

项目经验

-

这是简历的重头戏!详细描述你参与过的爬虫项目,包括:

- 项目背景(为什么要做这个项目?)

- 技术选型(用了哪些工具?为什么选择它们?)

- 挑战与解决方案(遇到了什么问题?如何解决的?)

- 项目成果(爬取了多少数据?有什么实际应用?)

-

工作/实习经历

- 如果有相关工作经验,一定要写上去!

-

强调你在工作中使用爬虫技术解决了哪些问题

-

教育背景

-

学校、专业、学历、毕业时间等

-

荣誉奖项

- 如果有相关的竞赛获奖或证书,一定要写上!

二、项目经验怎么写?

项目经验是简历的核心,怎么写才能吸引面试官?🤔

1. 项目描述要具体

不要只写“参与了一个电商爬虫项目”,而是要详细描述: - 目标:爬取哪些数据?用于什么用途? - 流程:如何分析网页结构?如何处理反爬机制? - 难点:遇到了哪些技术难题?如何解决的? - 成果:爬取的数据量、效率、稳定性等

2. 技术细节要突出

在描述项目时,重点突出你使用的技术和解决问题的能力: - 代码示例:可以写一些关键代码片段,展示你的编程能力 - 工具链:Scrapy框架的使用、数据库的优化等 - 反爬经验:如何处理验证码、动态加载、IP代理等问题

3. 数据量要量化

用数据说话最有说服力!比如: - “爬取了10万条商品数据” - “将爬取效率提升了50%” - “实现了数据的实时更新”

三、简历模板参考

这里提供一个简单的Python爬虫面试简历模板,供大家参考:

张三的简历

个人信息

- 姓名:张三

- 电话:138xxxxxxx

- 邮箱:zhangsan@example.com

- GitHub:https://github.com/zhangsan

专业技能

- Python爬虫:Requests、BeautifulSoup、Scrapy、Selenium、XPath、CSS选择器

- 数据库:MySQL、MongoDB

- 其他技能:Linux、Git、Pandas、NumPy

项目经验

1. 电商平台数据爬取项目

- 目标:爬取京东商品数据,用于价格监控

- 流程:分析网页结构,使用Scrapy框架编写爬虫,处理反爬机制

- 难点:验证码识别、动态加载

- 解决方案:使用OCR技术识别验证码,配合Selenium处理动态加载

- 成果:爬取了50万条商品数据,实现了每日数据更新

2. 新闻聚合平台

- 目标:爬取各大新闻网站内容,构建新闻聚合平台

- 流程:使用Requests+BeautifulSoup解析网页,使用MongoDB存储数据

- 难点:不同网站结构差异大

- 解决方案:编写通用解析器,动态调整选择器

- 成果:成功爬取了20家新闻网站的数据,用户量达到1万

工作经历

1. XX公司 | 爬虫开发工程师 | 2022.07 - 2023.06

- 负责公司内部数据爬取项目,优化爬虫效率

- 支持业务部门数据需求,提供数据解决方案

教育背景

- XX大学 | 计算机科学与技术 | 本科 | 2018.09 - 2022.06

荣誉奖项

- 2021年 全国大学生信息安全竞赛一等奖

四、注意事项

- 简历长度:控制在1-2页,别太长!

- 关键词:多使用Python爬虫面试简历撰写指南中的关键词,如Scrapy、Selenium、反爬等

- 排版:保持简洁美观,别用太多花哨的字体

- 真实性:所有内容都要真实,面试时可能会深挖细节

五、结尾

希望这份Python爬虫面试简历撰写指南能帮到大家!记住,简历是敲门砖,写得好才能获得面试机会!加油!💪💻

Python爬虫 #简历撰写 #面试准备 #技术分享

范文2

💻 Python爬虫面试简历撰写指南 | 简历范文参考

姐妹们!👋 想要进心仪的Python爬虫团队?一份优秀的简历是关键!今天就来分享Python爬虫面试简历撰写指南,附上范文参考,帮你轻松拿下Offer!✨

📄 简历结构建议

1. 个人信息

- 姓名:XXX

- 联系电话:XXX-XXXX-XXXX

- 邮箱:XXX@example.com

- GitHub/个人博客链接(可选)

2. 求职意向

- 岗位:Python爬虫工程师/数据分析师

- 期望城市:北京/上海/深圳等

3. 技能清单

- Python基础:熟练掌握Python语法、数据结构、常用库(如requests、BeautifulSoup、Scrapy)

- 爬虫框架:Scrapy、Requests-HTML、Selenium

- 数据库:MySQL、MongoDB、Redis

- 数据分析:Pandas、NumPy、Matplotlib

- 反爬虫:了解常见的反爬虫机制,如User-Agent、IP代理、验证码识别

- 项目经验:重点突出爬虫项目

4. 项目经验

(每个项目用STAR法则描述:Situation、Task、Action、Result)

项目1:某电商平台商品爬虫

项目描述: 为某电商平台爬取商品信息,包括标题、价格、销量等,用于数据分析和市场调研。

技术栈: - Python 3.8 - Scrapy 2.5 - MongoDB - Redis

实施过程: - Task:需要爬取10万+商品数据,处理动态加载和反爬机制。 - Action: - 使用Scrapy框架搭建爬虫,自定义Item Pipeline存储数据。 - 通过代理池和User-Agent轮换绕过反爬虫。 - 使用Selenium处理动态加载内容。 - Result:成功爬取数据并存储至MongoDB,数据准确率达98%,为后续分析提供支持。

项目2:新闻聚合网站爬虫

项目描述: 聚合多家新闻网站内容,构建个人新闻聚合器。

技术栈: - Python 3.7 - Requests-HTML - BeautifulSoup - SQLite

实施过程: - Task:需要实时抓取新闻标题和摘要,处理不同网站的解析规则。 - Action: - 使用Requests-HTML抓取页面,结合BeautifulSoup解析数据。 - 设计定时任务,每小时更新新闻数据。 - 优化数据库查询效率,减少响应时间。 - Result:实现新闻实时更新,用户反馈良好,日均访问量达1万+。

5. 工作经历(如有)

- 公司名称:XX科技有限公司

- 职位:Python开发工程师

- 时间:2022.03 - 2023.06

- 主要职责:

- 参与多个爬虫项目开发,优化爬虫效率。

- 与团队协作,完成数据清洗和预处理任务。

6. 教育背景

- 学校名称:XX大学

- 专业:计算机科学与技术

- 时间:2018.09 - 2022.06

7. 荣誉证书(可选)

- XX编程大赛一等奖

- XX技术认证

🌟 简历撰写小贴士

- 突出项目亮点:每个项目重点描述技术难点和解决方案,展现解决问题的能力。

- 量化成果:用数据说话,如“爬取数据量达10万条”“响应时间减少50%”。

- 关键词优化:在简历中自然融入“Python爬虫面试简历撰写指南”中的关键词,如“Scrapy”“反爬虫”“数据存储”等。

- 简洁明了:简历长度控制在1-2页,避免冗长描述。

- 格式规范:使用Markdown或Word格式,保持排版整洁。

📝 范文参考

张三 | Python爬虫工程师

联系方式

电话:138-XXXX-XXXX | 邮箱:zhangsan@example.com | GitHub:github.com/zhangsan

求职意向

Python爬虫工程师 | 北京

技能清单

- Python基础:熟练掌握语法、数据结构、requests、BeautifulSoup、Scrapy

- 爬虫框架:Scrapy、Selenium、Requests-HTML

- 数据库:MySQL、MongoDB、Redis

- 数据分析:Pandas、NumPy

- 反爬虫:User-Agent轮换、IP代理、验证码识别

项目经验

某电商平台商品爬虫

为某电商平台爬取商品信息,用于数据分析和市场调研。

- 使用Scrapy框架,自定义Pipeline存储数据至MongoDB。

- 通过代理池和User-Agent轮换绕过反爬虫。

- 数据准确率达98%,为后续分析提供支持。

新闻聚合网站爬虫

聚合多家新闻网站内容,构建个人新闻聚合器。

- 使用Requests-HTML抓取页面,结合BeautifulSoup解析数据。

- 设计定时任务,每小时更新新闻数据。

- 日均访问量达1万+,用户反馈良好。

工作经历

XX科技有限公司 | Python开发工程师 | 2022.03 - 2023.06

- 参与多个爬虫项目开发,优化爬虫效率。

- 与团队协作,完成数据清洗和预处理任务。

教育背景

XX大学 | 计算机科学与技术 | 2018.09 - 2022.06

荣誉证书

XX编程大赛一等奖

姐妹们,这份Python爬虫面试简历撰写指南和范文参考你get了吗?👍 记得根据自身情况修改和优化,祝你面试顺利,Offer拿到手软!💪💖

范文3

Python爬虫面试简历撰写指南 | 简历范文分享✨

姐妹们!👭 最近好多宝子问我Python爬虫面试简历怎么写才出彩,今天就来掏心窝子分享我的经验啦!作为曾经的HR和爬虫工程师,我总结了超实用的Python爬虫面试简历撰写指南,快拿出小本本记下来!💼

📝 简历开头:让HR一眼看到你

个人信息区

姓名、联系方式、邮箱、GitHub链接(超级重要!里面放你的爬虫项目!)、个人博客(可选)。记住,简洁明了,别整花里胡哨的。

个人简介(必加项!)

用3句话概括你的核心优势:

- "3年Python爬虫开发经验,精通Scrapy、Requests库,擅长反爬策略应对。"

- "曾独立完成电商平台数据采集项目,效率提升30%,为业务决策提供关键数据。"

- "持续学习新技术,熟悉MongoDB、Redis数据存储,具备良好的代码规范习惯。"

关键词魔法

在简介里自然融入"Python爬虫面试简历撰写指南"中的核心技能词:Scrapy、Requests、BeautifulSoup、Selenium、反反爬、数据清洗、分布式爬虫等。这样HR秒懂你的专业性!

🌟 技能清单:量化你的战斗力

别只列技能名称!用数据说话才是王道:

- "Python爬虫框架:Scrapy(熟练度9/10,主导过百万级数据采集项目)"

- "反爬虫技术:熟练使用代理池、User-Agent轮换、验证码识别(OCR+打码平台)"

- "数据库:MongoDB(数据模型设计)、Redis(缓存优化)、SQL(数据关联分析)"

- "工具链:Requests+BeautifulSoup(传统爬取)、Selenium+ChromeDriver(动态页面突破)"

特别提醒

在Python爬虫面试简历撰写指南里要重点突出你的"技术栈深度",比如你会用Scrapy实现分布式爬虫,但更厉害的是你知道如何优化Scheduler和Downloader Middleware来提升效率。

📈 项目经历:用结果证明能力

HR最关心的是你的项目价值!按STAR法则写:

项目A:某电商反爬虫系统

情境(S):平台反爬策略升级,原有采集工具失效

任务(Task):7天内重构爬虫体系

行动(Action):

1️⃣ 设计代理池+验证码识别链路(结合第三方打码平台)

2️⃣ 优化Scrapy中间件,降低被封锁率至0.5%以下

3️⃣ 实现MongoDB增量存储,日均处理数据50万条

结果(Result):获公司年度技术攻坚奖,采集成本降低60%

项目B:金融数据实时监控

情境:需要抓取3000+上市公司动态数据

行动:

- 用Selenium+Redis会话池突破JS加密

- 开发多线程异步处理模块,响应时间<500ms

- 设计数据清洗脚本,错误率控制在0.1%内

结果:为风控系统提供实时数据支撑,获用户好评

关键点

在Python爬虫面试简历撰写指南中要记住:每个项目必须体现"技术难点"和"业务价值"。比如反爬项目要写明你如何绕过验证码,金融数据项目要说明你的处理速度如何支持实时决策。

💡 开源贡献:让面试官眼前一亮

GitHub是加分项!放这些内容:

- 个人爬虫框架(比如封装通用反反爬逻辑)

- 爬虫教学项目(带注释的完整代码)

- 参与的开源库(如贡献Scrapy插件)

- 定期发布的爬虫小工具(爬取疫情数据等社会价值项目)

记住

在Python爬虫面试简历撰写指南里要强调你的"代码质量",比如在GitHub上给项目打上good first issue标签,这样大厂面试官会主动找你深聊!

🔔 面试加分项:细节决定成败

- 数据可视化:用matplotlib/echarts展示爬虫效率提升曲线

- 异常处理:写你如何设计重试机制(指数退避)

- 安全意识:说明你了解robots.txt协议和法律法规

- 个人成长:记录从用Requests到Scrapy的技术升级历程

小贴士

在Python爬虫面试简历撰写指南最后要附上你的学习路径图,标明每个阶段掌握的核心技能,体现持续进化的能力。

✨ 结语

搞定这份Python爬虫面试简历撰写指南,你的简历至少能通过初筛!记住:技术深度+业务价值+代码规范是完美组合。祝大家面试顺利,拿到心仪的Offer!💖

需要更多爬虫面试技巧的宝子,评论区见~ 💌

发布于:2025-12-01,除非注明,否则均为原创文章,转载请注明出处。